Facebook告密人:点赞和分享功能给年轻用户带来压力和焦虑

腾讯科技讯10月26日消息,点赞和分享成就了社交媒体网站Facebook。如今,该公司的文件显示,其正在努力应对它们的影响。

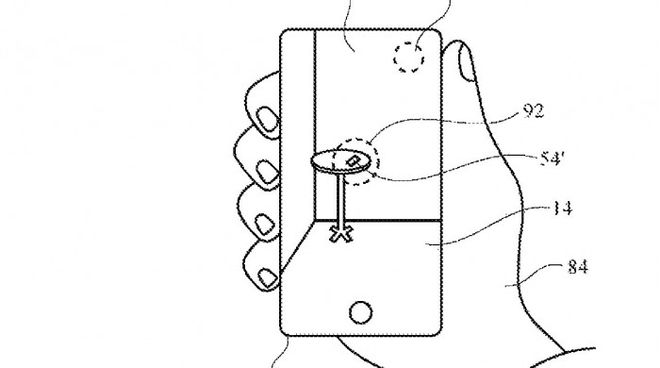

报道称,Facebook的研究人员从2019年开始了一项新的研究,研究Facebook的一个基本特征:“喜欢”按钮。根据公司文件,他们研究了如果Facebook从照片分享应用Instagram的帖子中删除明显的竖起大拇指图标和其他表情反应,人们会怎么做。结果发现,这些按钮有时会给Instagram最年轻的用户带来“压力和焦虑”,尤其是当帖子没有得到足够多朋友的点赞时。

但研究人员发现,当“喜欢”按钮被隐藏时,用户与帖子和广告的互动会减少。与此同时,它并没有缓解青少年的社交焦虑,年轻用户也没有像Facebook认为的那样分享更多的照片,导致结果喜忧参半。

文件显示,Facebook首席执行官马克·扎克伯格(Mark Zuckerberg)和其他高管讨论了为更多Instagram用户隐藏“喜欢”按钮的问题。最终,一个更大的围绕Instagram“建立积极的媒体叙事”的测试在有限的范围内展开。

对“喜欢”按钮的研究是Facebook质疑社交网络基本特征的一个例子。随着该公司在错误信息、隐私和仇恨言论方面面临一次又一次的危机,核心问题是该平台的基本运作方式是否出了问题--本质上,正是这些特征成就了Facebook。除了“喜欢”按钮之外,Facebook还仔细检查了可以让用户即时传播他人发布内容的“分享”按钮,用于形成数字社区的群组功能,以及定义超过35亿人在线行为和互动方式的其他工具。这项研究展示在数千页的内部文件中,突显出Facebook如何反复努力应对自己创造的东西。

研究人员发现的情况往往远非正面。他们一次又一次地认定,人们滥用了关键功能,或者这些功能放大了有毒物质,还有其他影响。在2019年8月的一份内部备忘录中,若干位研究人员表示,是Facebook的“核心产品机制”--即产品如何运作的基础--让错误信息和仇恨言论在网站上泛滥。“我们平台的机制不是中立的,”他们总结说。“我们也有令人信服的证据表明,我们的核心产品机制,如虚拟性、推荐和参与优化,是这些类型的内容在平台上蓬勃发展的重要原因。如果诚信对这些问题采取不干涉的立场,无论是出于技术(精确)还是哲学原因,那么最终结果是,Facebook作为一个整体,将积极(如果不一定是有意识地)促进这些类型的活动。我们平台的机制并不中立。”

这些文件--包括幻灯片、内部讨论线索、图表、备忘录和演示文稿--没有显示Facebook在收到调查结果后采取了什么行动。近年来,该公司改变了一些功能,使人们更容易隐藏他们不想看到的帖子,并关闭政治团体的建议,以减少错误信息的传播。但Facebook运营的核心方式--一个信息可以迅速传播、人们可以积累朋友、追随者和点赞的网络--最终基本上保持不变。一些现任和前任高管表示,Facebook的许多重大修改都被阻止,以服务于增长和保持用户参与。目前,Facebook的市值超过了9000亿美元。

去年离职的Facebook副总裁布莱恩·博兰(Brian Boland)说:“作为一名员工,你可以在Facebook内部进行相当公开的对话。但实际上,完成变革可能要困难得多。”

这些公司文件是告密者、Facebook前雇员弗朗西斯·豪根(Frances Haugen)的代理律师提供给美国证券交易委员会和美国国会的“Facebook档案”的一部分。豪根女士早些时候把这些文件交给了《华尔街日报》。本月,一名国会工作人员向十几家新闻机构提供了经过编辑的披露内容。

Facebook发言人安迪·斯通(Andy Stone)在声明中批评了基于这些文件的文章,称这些文章建立在“错误的前提”上。“诚然,我们是一家企业,我们要赚钱,但我们这样做是以牺牲人民的安全或福祉为代价的想法误解了我们自己的商业利益所在,”他说。斯通表示,Facebook已投资了130亿美元,雇佣了4万多人来保护人们的安全,并补充说,该公司呼吁“更新法规,让民主政府制定我们都能遵守的行业标准。”

扎克伯格在本月的一篇帖子中表示,该公司将有害内容放在优先位置是“非常不合逻辑的”,因为Facebook的广告商不想在传播仇恨和错误信息的平台上购买广告。他指出:“在最基本的层面上,我认为我们大多数人就是认不出正在被粉刷的公司的虚假图片。”

成功的基础

当扎克伯格17年前在哈佛大学宿舍创办Facebook时,该网站的使命是将大学校园里的人联系起来,并把他们带入有共同兴趣和地点的数字群体。当Facebook在2006年推出由用户好友发布的照片、视频和状态更新组成的动态消息之后,该公司迎来了爆炸式的增长。2009年,Facebook推出了拥有点赞功能的“喜欢”按钮。这个小小的竖起大拇指的符号,是一个简单的人们偏好的指示器,成为了社交网络最重要的特征之一。Facebook允许其他网站采用“喜欢”按钮,这样用户就可以将他们的兴趣分享回他们的Facebook个人资料。

这让Facebook能够洞察人们在自己网站之外的活动和情绪,因此它可以更好地利用广告来锁定他们。点赞也意味着用户希望在他们的动态消息中看到更多的内容,这样人们就可以花更多的时间在Facebook上。

Facebook还增加了群组功能,人们可以通过私人交流渠道谈论特定的兴趣,让企业和名人积累大量粉丝,并向这些粉丝传播信息。

另一个创新是“分享”按钮,人们用来快速分享他人发布到自己的动态消息或其他地方的照片、视频和消息。一个自动生成的推荐系统还根据人们以前的在线行为,为他们推荐新的群组、好友或页面。

不过根据文件,这些功能有副作用。有些人开始用点赞来比较自己和别人。其他人利用分享按钮快速传播信息,因此虚假或误导性的内容在几秒钟内就像病毒一样传播开来。当人们被要求回忆一次在Instagram上引发负面社会比较的经历时,他们可能会将这种负面感觉归因于点赞的数量。

Facebook表示,它进行内部研究的部分目的是找出可以调整的问题,使其产品更加安全。Instagram负责人亚当·莫塞里(Adam Mosseri)表示,对用户福祉的研究导致了对Instagram上反欺凌措施的投资。

Facebook档案

一名前Facebook员工泄露内部文件,让人们近距离观察了这家神秘社交媒体公司的运作,并再次呼吁对该公司深入用户生活的广泛领域进行更好的监管。

今年9月,媒体开始连载基于泄露的Facebook文件撰写的系列报道《Facebook档案》。连载文件揭露了Facebook知道其产品之一Instagram正在青少年中恶化身体形象问题的证据。10月3日,告密者豪根在电视节目《60分钟》中现身。作为今年5月离职的前Facebook产品经理,豪根透露她对那些内部文件的泄露负有责任。

10月5日,豪根在美国参议院小组委员会作证时表示,为了让用户回来,Facebook愿意在网站上使用仇恨和有害的内容。包括扎克伯格在内的脸书高管称她的指控不真实。豪根还向美国证券交易委员会提交了诉讼。随后,一名国会工作人员向包括多家新闻机构提供了这些被称为“Facebook档案”的文件。

“Facebook档案”显示了Facebook对其网站上试图在选举前分化美国选民的极端组织的了解程度。他们还透露,内部研究人员曾多次确定Facebook的关键功能如何放大平台上的有毒内容。然而,研究社交网络和错误信息的哈佛大学肯尼迪·肖伦斯坦中心高级研究员简·利文内科(Jane Lytvynenko)说,当如此多的问题追溯到核心功能时,Facebook不能简单地调整自己,使自己成为一个更健康的社交网络。她说:“当我们谈论喜欢按钮、分享按钮、动态消息以及它们的功能时,我们本质上是在谈论网络构建在其上的基础设施。这里的问题关键是基础设施本身。”

自我检查

随着Facebook的研究人员深入研究其产品的工作原理,令人担忧的结果越来越多。在2019年7月的一项群组研究中,研究人员追踪了这些社区的成员如何成为错误信息的目标。研究人员说,起点是被称为“邀请鲸鱼”的人,他们向其他人发出邀请,让他们加入一个私人团体。

研究称,这些人有效地让成千上万的人加入新的团体,使得社区几乎在一夜之间膨胀起来。根据这项研究,邀请鲸鱼可以向这些群体发送宣扬种族暴力或其他有害内容的帖子。另一份2019年的报告研究了一些人如何在他们的Facebook页面上积累大量粉丝,经常使用关于可爱动物和其他无害话题的帖子。但是一旦一个页面增长到成千上万的追随者,创始人就会卖掉它。根据这项研究,购买者然后用这些页面向追随者展示错误信息或政治分裂的内容。

文件显示,当研究人员研究“喜欢”按钮时,高管们也考虑在Facebook上隐藏该功能。2019年9月,在澳大利亚的一个小实验中,它从用户的Facebook帖子中删除了点赞。该公司想看看这一变化是否会减轻用户的压力和社会比较。这反过来可能会鼓励人们更频繁地在网络上发帖。但是在“喜欢”按钮被移除后,人们没有分享更多的帖子。Facebook选择不进行更广泛的测试,他指出,“在我们需要解决的一长串问题中,点赞问题排位非常靠后。”

去年,公司研究人员也对分享按钮进行了评估。在2020年9月的一项研究中,一名研究人员写道,动态消息中的分享按钮旨在“吸引注意力和鼓励参与。”但如果不加以控制,这些功能可能会“放大不良内容和来源”,例如欺凌和边缘裸体帖子。这是因为这些功能让人们在分享帖子、视频和信息时不再犹豫。

文件中的一个共同线索是,Facebook员工如何主张改变社交网络的运作方式,并经常指责高管们碍事。在2020年8月的一篇内部帖子中,一名Facebook研究人员批评了推荐系统,该系统建议人们使用页面和群组,并表示它可以“非常迅速地引导用户走向阴谋论和群组。”

“出于对潜在公共和政策利益相关者反应的担忧,我们有意让用户面临诚信受损的风险,”该研究人员写道。“在我们犹豫不决的时候,我看到来自我家乡的人们越来越深入像匿名者Q、反疫苗接种和新冠肺炎阴谋这样的阴谋论运动。”研究人员补充说,“观察起来很痛苦。”

本文来自“腾讯科技”,编译:无忌,36氪经授权发布。